2ヶ月前にアップされた技術戦略研究センターレポートからの要約である。とてつもない努力で、精一杯優しく書かれているから、なんとかジジーにもついていける。ありがたい話だ。

1. AI 技術の開発経緯

IoT(Internet of Things)

物事がデジタルデータとして情報化され、インターネットによって結びついてゆく技術

CPS(CyberPhysical Systems)

身の回りの実空間とこれに対応するデータによるサイバー空間とが連結したシステム

を中軸としたAI 技術の開発が進んでいる。中でも注目されるのがディープニューラルである。

2010年頃からディープニューラルネットワークが開発された。“隠れ層” をさらに増やし、ニューロン数を数百万以上にまで高めることで、高い能力を発揮している。

このネットワークによるディープラーニングは、あの「アルファGO」のように名人を打ち負かすほどの能力を持つようになった。

これを可能にしたのはGPU (画像処理チップ) であった。GPUは元々グラフィックス用の演算チップだが、その高並列演算機能が汎用計算にも適用できることが見つかり、応用・改良が進んでいる。

2. ニューロンモデルの説明

現在使われているコンピュータはノイマン型コンピュータと言われ、プロセッサとメモリに分かれている。

メモリ中にプログラムとデータが蓄えられ、プロセッサはそこからプログラムを逐次読み出す。ついでその命令コードにしたがってメモリ中のデータを処理する。

メモリとプロセッサは伝達経路である「バス」によって結合されているが、このバス結合が隘路となってコンピュータの実行速度を落としている。これを “ノイマン・ボトルネック” という。

このボトルネックをどう回避するかが問われてきた。

ニューラルネットワークはメモリ=プロセッサ構造を破棄することで、ボトルネックそのものをなくしてしまうという発想だ。

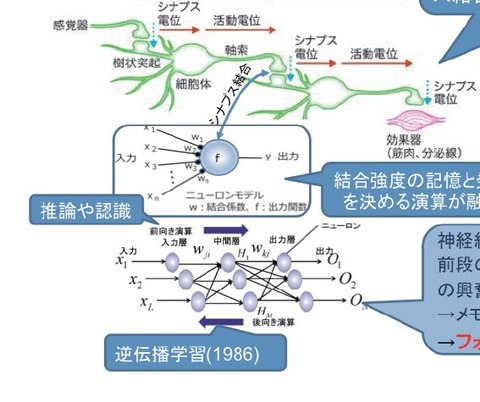

下の図が概念図で、上段が動物のニューロン、中段がこれを図式化したニューロンモデルだ。そしてこれをネットワークに編み上げたのか下段になる。

「神経細胞はシナプスの結合強度を記憶する」と書いてあるから、むかしの伊東ゆかりの「小指の想い出」♭あなたが嚼んだ、小指が痛い~ ということなのだろう。

その後の経過は省略する。

それで脳型コンピュータへの転換は、一つのゴールなのかと思ったらそうではない。

下の図のように、そのお次には「量子コンピュータ」が控えている。

量子コンピュータは、計算単位として、0または1または量子力学的な重ね合せ状態を確率として持つ量子ビット(Qubit)を用いる。現在、量子コンピュータはその適用範囲を含めて各国で研究開発が進んでいる。

のだそうだが、そんなことは分かる必要はない。さすがに、そこまで生きていることはないだろう。

3.コンピュータの世代区分

いまの先端研究の立ち位置は、ノイマン時代を越えて、非ノイマンに入ったところ、脳型コンピュータではあるが、古典ニューラルネットワークとニューロモーフィックの混在する時期にあるようだ。

4.技術開発競争の動向

AIを支えるハードウェアの市場規模は2020年以降から大幅に増加するだろうと言われている。予測では2025年の世界市場が約6.7兆円となるのだそうだ。まさに巨大市場であるが、それ以上に安全保障をふくめて国家の生死を決めるような技術となる可能性がある。

特許争いも熾烈となっており、目下はとくに脳型(ニューロモーフィック)コンピュータが主戦場となっている。2010年ごろから出願数が激増しているが、ただし日本はお呼びではない。

日本の産業トップと経産省がいかに日本をだめにしたかがよく分かる。対米従属と内部留保に血道を上げた結果がこのザマだ。